Quando l’intelligenza artificiale bara: l’aneddoto degli husky scambiati per lupi

Una delle sfide nell’uso delle straordinarie possibilità dell’intelligenza artificiale è molto, molto… umana: le persone che sviluppano questi sistemi devono abituarsi a ragionare in maniera non umana e a capire e prevedere gli sbagli del loro software.

C’è un caso molto famoso in questo campo che viene spesso citato come aneddoto: si racconta che alcuni anni fa un gruppo di ricercatori creò un sistema di intelligenza artificiale per distinguere i lupi dai cani husky, dandogli in pasto immagini di lupi e di husky e dicendogli quali erano lupi e quali erano husky. Un metodo molto simile a quello che si usa per insegnare a una persona a riconoscere qualunque oggetto.

Nell’aneddoto, il sistema funzionava benissimo: aveva un tasso di successo molto elevato quando gli venivano proposte immagini che non aveva mai visto prima. Ma a un certo punto aveva iniziato a commettere una serie di errori madornali. I ricercatori, si racconta, scoprirono poi che il sistema non stava in realtà riconoscendo lupi o cani, ma stava discriminando le immagini in base alla presenza o assenza di neve. Infatti tutte le immagini di lupi che erano state usate per addestrare l’intelligenza artificiale avevano uno sfondo innevato e quelle degli husky no, e i ricercatori non ci avevano fatto caso.

—

L’aneddoto è divertente; illustra bene un problema frequente dei ricercatori di intelligenza artificiale, ossia la tendenza a fare una selezione errata dei campioni usati per l’addestramento del software, ma in realtà l’aneddoto racconta i fatti in modo sbagliato.

Prima di tutto, la ricerca fu effettivamente realizzata (è descritta in un articolo scientifico del 2016, disponibile qui su Arxiv.org) e diede davvero quei risultati, ma l’intelligenza artificiale fu creata appositamente difettosa (“We trained this bad classifier intentionally”) per dimostrare l’importanza di usare immagini campione ben selezionate e mettere in chiaro il pericolo delle cosiddette correlazioni spurie e dell’eccessiva fiducia che si rischia di dare a sistemi addestrati maldestramente.

Le correlazioni spurie sono quelle che un essere umano non farebbe mai, perché sa cos’è un husky e cos’è un lupo in base alla propria conoscenza degli animali e della realtà in generale, ma che un’intelligenza artificiale rischia di fare perché si basa esclusivamente sulle immagini che le sono state date, senza alcuna conoscenza della realtà: dove noi vediamo husky o lupo, l’intelligenza artificiale vede macchie di pixel che si somigliano oppure no.

L’aspetto più interessante di questo aneddoto è un altro elemento che manca nella sua narrazione abituale: i risultati dell’intelligenza artificiale furono presentati a un gruppo di studenti laureati del settore, mostrando loro otto riconoscimenti corretti e uno sbagliato, nel quale l’intelligenza artificiale aveva identificato come lupo quello che in realtà era un husky.

Agli studenti fu chiesto se ritenessero affidabile un software che azzeccava otto volte su nove, perché lo ritenessero affidabile, e quale fosse secondo loro il criterio usato dal software per distinguere lupi e husky.

Solo in seguito fu spiegato loro il criterio effettivamente utilizzato dall’intelligenza artificiale, ossia la presenza o assenza di bianco nella parte inferiore dell’immagine.

Prima di conoscere il criterio, oltre un terzo degli studenti aveva dichiarato di fidarsi del software e meno della metà aveva citato la presenza di neve come possibile elemento discriminante spurio usato per errore dall’intelligenza artificiale. Una volta conosciuto il criterio effettivo, la loro fiducia era calata notevolmente.

Gli studenti avevano insomma dato fiducia a quest’intelligenza artificiale basandosi puramente sulle sue statistiche di successo, ragionando che se funziona otto volte su nove vuol dire che funziona bene, fine del problema. Se questo errore capita a degli esperti del settore, immaginatevi quanto possa capitare a chi non è esperto.

Proprio in questi giorni sulla prestigiosa rivista medica The Lancet è stato pubblicato un articolo (segnalato da Eric Topol) che racconta un incidente analogo capitato in un settore ben più delicato: quello della salute. Un modello di intelligenza artificiale concepito per riconoscere fratture femorali nelle radiografie dei pazienti aveva prodotto risultati praticamente perfetti, superiori a quelli dei radiologi in carne e ossa, ma a un certo punto aveva manifestato “comportamenti algoritmici inattesi e potenzialmente dannosi” (“unexpected and potentially harmful algorithmic behaviour”). Che è un eufemismo per dire che prendeva delle cantonate spettacolari che avrebbero potuto rovinare i pazienti.

L’articolo di Lancet non nega il potenziale di queste tecnologie, ma mette in luce le necessità di esaminare con attenzione il modo in cui funzionano prima di introdurle nella pratica clinica, per evitare che ci si basi su criteri che sono robusti e sensati soltanto in apparenza. “Storicamente”, dicono gli autori dell’articolo, “i sistemi di diagnosi assistita da computer hanno spesso fornito prestazioni inaspettatamente scadenti in contesto clinico nonostante valutazioni precliniche promettenti”.

Per fortuna c’è, secondo loro, una soluzione: obbligare chi offre questi sistemi a spiegare come funzionano realmente e a sottoporli a verifiche da parte di esperti di intelligenza artificiale, secondo una tecnica denominata algorithmic auditing.

Insomma, sembra proprio che l’intelligenza artificiale ci possa dare una mano, a patto di addestrarla bene, e sembra anche scongiurato un altro pericolo che viene spesso citato: quello che l’intelligenza artificiale causi disoccupazione. Per fare questo algorithmic auditing serviranno infatti persone esperte sia in campo informatico sia nel campo nel quale si vogliono applicare questi sistemi, e serviranno anche decisori che sappiano che non ci si può semplicemente fidare di un numeretto che indica una percentuale di successo ma occorre piena trasparenza.

Nascono quindi nuovi mestieri che si affiancano a quelli tradizionali. Sperando che chi li farà non venga selezionato da un software che li sceglie in base a qualche correlazione spuria o campione distorto, come è accaduto ad Amazon. Nel 2018 l’azienda di Jeff Bezos ha dovuto rinunciare a un sistema automatico di selezione dei candidati quando è emerso (dice Reuters) che discriminava le donne. Il software, infatti, era stato addestrato usando i curricula inviati ad Amazon nei dieci anni precedenti, e la maggior parte di quei curricula era maschile, per cui il sistema di machine learning aveva dedotto (si fa per dire) che i candidati maschili erano da preferire a quelli femminili.

Huawei Mate 50 avrà il nuovo Qualcomm di punta ma senza il 5G

Apple ripara il Face ID su iPhone X senza sostituire l’intero device

Samsung Galaxy Z Fold4: sarà il miglior foldable di sempre?

Samsung Galaxy Buds2, OFFERTA FOLLE Amazon (90€)

Trasforma la tua bici in una e-bike elettrica con questo kit

<div>Here’s how online shoppers are finding inspiration</div>

People shop across Google more than a billion times a day — and we have a pretty good sense of what they’re browsing for. For instance, our Search data shows that the early 2000’s are having a moment. We’re seeing increased search interest in “Y2k fashion” and products like bucket hats and ankle bracelets. Also popular? The iconic Clinique “Happy” perfume, Prada crochet bags and linen pants.

While we know what’s trending, we also wanted to understand how people find inspiration when they’re shopping for lifestyle products. So we surveyed 2,000 U.S. shoppers of apparel, beauty and home decor for our first Inspired Shopping Report. Read on to find out what we learned.

Shopping isn’t always a checklist

According to our findings, most fashion, beauty and home shoppers spend up to two weeks researching products before they buy them. Many, though, are shopping online just for fun — 65% say they often or sometimes shop or browse online when they’re not looking for anything in particular. To help make online shopping even easier and more entertaining, we recently added more browsable search results for fashion and apparel shopping queries. So when you search for chunky loafers, a lime green dress or a raffia bag on Google, you’ll scroll through a visual feed with various colors and styles — alongside other helpful information like local shops, style guides and videos.

Apparel queries on Search show a more visual display of products

Inspiration can strike anywhere

We know shopping inspiration can strike at any moment. In fact, 60% of shoppers say they often or sometimes get inspired or prompted to buy something even when they aren’t actively shopping. That can come from spotting great street style: 39% of shoppers say they often or sometimes look for a specific outfit online after they see someone wearing it. Or it can come from browsing online: 48% of shoppers have taken a screenshot of a piece of clothing, accessory or home decor item they liked (and 70% of them say they’ve searched for or bought it afterwards). Google Lens can help you shop for looks as soon as you spot them. Just snap a photo or screenshot and you’ll find exact or similar results to shop from.

Sometimes words aren’t enough

We know it can be hard to find what you’re looking for using words alone, even when you do have an image — like that multi-colored, metallic floral wallpaper you took a photo of that would go perfectly with your living room rug. Half of shoppers say they often or sometimes have failed to find a specific piece of clothing or furniture online after trying to describe it with just words. And 66% of shoppers wished they could find an item in a different color or print.

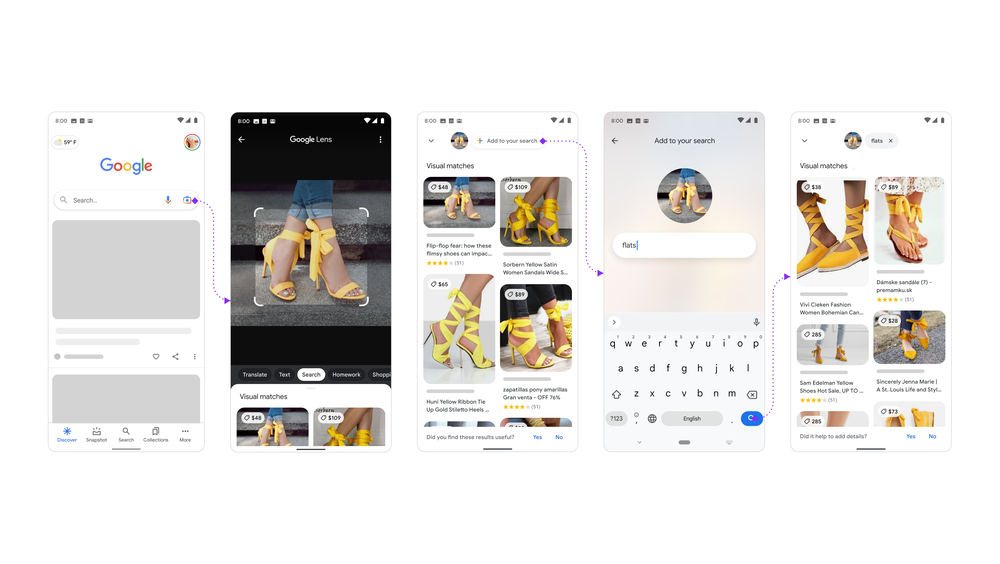

To help you track down those super specific pieces, we’re introducing an entirely new way to search — using text and images at the same time. With multisearch on Lens, you can better uncover the products you’re looking for even when you don’t have all the words to describe them. For example, you might be on the lookout for a scarf in the same pattern as one of your handbags. Just snap a photo of the patterned handbag on Lens and add the query “scarf” to complete your look. Or take a photo of your favorite heels and add the query “flats” to find a more comfortable version.

With multisearch on Lens, you can search with both images and text at the same time

Trying before you buy matters

It’s not always possible to make it to the store and try something on before you buy it — but it matters. Among online beauty shoppers, more than 60% have decided not to purchase a beauty or cosmetic item online because they didn’t know what color or shade to choose, and 41% have decided to return an item because it was the wrong shade. With AR Beauty experiences, you can virtually discover and “try on” thousands of products from brands like Maybelline New York, M.A.C. and Charlotte Tilbury — helping you make more informed decisions. And now, shoppers can try on cosmetics from a variety of brands carried at Ulta Beauty right in Google Search. Just search for a product, like the Morphe Matte Liquid Lipstick or Kylie Cosmetics High Gloss, and find the best shade for you.

Google’s AR Beauty experience features products from Ulta Beauty

No matter where you find your shopping inspiration, we hope these features and tools help you discover new products, compare different options and ultimately make the perfect purchase.

Go beyond the search box: Introducing multisearch

How many times have you tried to find the perfect piece of clothing, a tutorial to recreate nail art or even instructions on how to take care of a plant someone gifted you — but you didn’t have all the words to describe what you were looking for?

At Google, we’re always dreaming up new ways to help you uncover the information you’re looking for — no matter how tricky it might be to express what you need. That’s why today, we’re introducing an entirely new way to search: using text and images at the same time. With multisearch in Lens, you can go beyond the search box and ask questions about what you see.

Let’s take a look at how you can use multisearch to help with your visual needs, including style and home decor questions. To get started, simply open up the Google app on Android or iOS, tap the Lens camera icon and either search one of your screenshots or snap a photo of the world around you, like the stylish wallpaper pattern at your local coffee shop. Then, swipe up and tap the “+ Add to your search” button to add text.

Multisearch allows people to search with both images and text at the same time.

With multisearch, you can ask a question about an object in front of you or refine your search by color, brand or a visual attribute. Give it a go yourself by using Lens to:

- Screenshot a stylish orange dress and add the query “green” to find it in another color

- Snap a photo of your dining set and add the query “coffee table” to find a matching table

- Take a picture of your rosemary plant and add the query “care instructions”

All this is made possible by our latest advancements in artificial intelligence, which is making it easier to understand the world around you in more natural and intuitive ways. We’re also exploring ways in which this feature might be enhanced by MUM– our latest AI model in Search– to improve results for all the questions you could imagine asking.

This is available as a beta feature in English in the U.S., with the best results for shopping searches. Try out multisearch today in the Google app, the best way to search with your camera, voice and now text and images at the same time.

MicroSD SanDisk 256GB, falla tua a METÀ PREZZO (31€)

<div>iPad Air (2022): è quello giusto un po’ per tutti! La recensione</div>

INPS, è di nuovo allarme malware: occhio alla truffa online

WhatsApp: nuova campagna phishing

Linux Mint 21 si baserà su Ubuntu 22.04 LTS

Microsoft Teams per Firefox

Nello spazio nessuno può sentirti urlare, ma su Marte sì

Siamo abituati a pensare che lo spazio sia un ambiente totalmente silenzioso, perché nel vuoto i suoni non si propagano. Il film Alien (un classico del 1979) divenne famoso per il suo slogan “nello spazio nessuno può sentirti urlare”. Le immagini delle sonde spaziali o degli astronauti sulla Luna sono sempre silenziose o al massimo sono accompagnate dalle loro comunicazioni via radio. Ma non è sempre così.

Il suono non si propaga nello spazio, ma su Marte, per esempio, sì. Il pianeta, infatti, è dotato di un’atmosfera. È molto tenue, rispetto a quella terrestre, ma c’è, e quindi i suoni si possono sentire. A patto, però, che ci sia qualcuno o qualcosa a produrli e ad ascoltarli.

Su YouTube è stato pubblicato un video che presenta suoni di Marte, e non si tratta di uno scherzo: sono realmente suoni captati sul pianeta rosso.

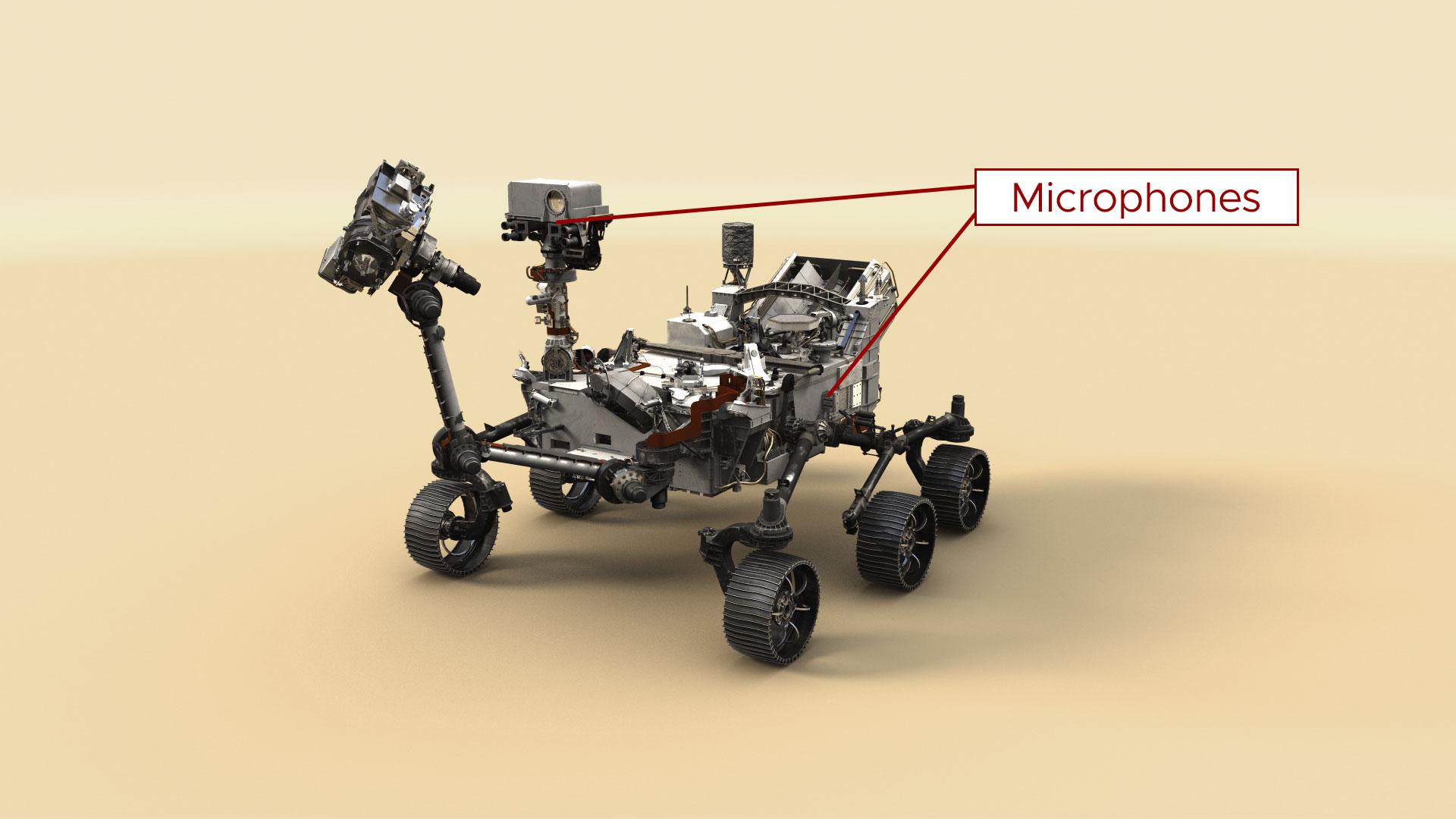

Il video è opera del Jet Propulsion Laboratory della NASA e presenta i suoni captati su Marte dai due microfoni montati per questo scopo sul veicolo robotico Perseverance, che sta esplorando il pianeta da più di un anno (è arrivata su Marte a febbraio del 2021).

Nel video si sentono degli sbuffi, prodotti dal getto gassoso usato per soffiare via la polvere prodotta dagli strumenti che analizzano le rocce marziane: i crepitii del laser usato per vaporizzare le rocce allo scopo di conoscerne la composizione chimica; il fruscìo del vento marziano; e anche il rumore del piccolo drone Ingenuity, il primo veicolo a elica usato su un altro mondo.

L’idea di montare dei microfoni su una sonda spaziale può sembrare frivola, e inizialmente fu bocciata dalla NASA, diventando realtà soltanto grazie a una colletta di 100.000 dollari realizzata via Internet dall’associazione di divulgazione scientifica Planetary Society. In realtà ascoltare i suoni di un altro pianeta ha permesso ai ricercatori di scoprire alcune strane caratteristiche dell’atmosfera di Marte.

Per esempio, su Marte il suono si propaga più lentamente che sulla Terra e a velocità differenti a seconda della frequenza. I suoni di bassa frequenza viaggiano sul pianeta rosso a circa 240 metri al secondo, mentre quelli più acuti si propagano più rapidamente, a circa 250 metri al secondo. Un concerto su Marte produrrebbe insomma effetti molto strani: le note alte arriverebbero agli ascoltatori prima di quelle basse. I suoni marziani in generale sono inoltre più lenti che sulla Terra, dove viaggiano normalmente a circa 343 metri al secondo.

Questi sono effetti della composizione chimica dell’atmosfera marziana, che oltre a essere molto sottile e molto fredda è composta principalmente da anidride carbonica. Gli scienziati avevano previsto questi fenomeni, ma sentirli confermare direttamente da una registrazione audio è una bella soddisfazione.

Un altro effetto insolito dell‘atmosfera marziana è che i suoni non vanno molto lontano, e quelli acuti si propagano meno di quelli bassi. Sulla Terra un suono normalmente si smorza fortemente dopo una sessantina di metri, mentre su Marte i suoni acuti si perdono completamente già a otto metri di distanza, scrive il JPL. Lo si nota nel rumore del drone Ingenuity nel video, i cui piccoli rotori girano velocissimi, a 2500 giri al minuto, ma nell’atmosfera marziana producono un suono molto cupo. Il risultato è che se una persona potesse stare senza protezioni su Marte, sentirebbe quasi sempre un silenzio totale, punteggiato solo occasionalmente da rumori sordi.

Marte è davvero un mondo alieno, insomma, nel quale per farsi sentire non conviene strillare ma è invece necessario usare toni molto bassi e stare vicini. Ed è affascinante che si possano udire questi suoni alieni che arrivano da decine di milioni di chilometri di distanza, e ci si possa fare un’idea di cosa sentiremmo se fossimo lì di persona, su Marte, grazie a una colletta fatta su Internet.